Online Hearing "Targeted Killing oder das Versprechen, die 'Richtigen' zu treffen"

Ein breites Bündnis der Zivilgesellschaft gegen bewaffnete Drohnen lädt zu einer öffentlichen Online-Debatte über Fragen der Verantwortung, historischen Kontinuitäten und konkreten Folgen vom militärischen Gebrauch KI-gestützter Decision Support Systeme ein

Die FIfF-Mitglieder Christian Heck und Hans-Jörg Kreowski haben zusammen mit Susanne Grabenhorst von der IPPNW im Rahmen des Arbeitskreises gegen bewaffnete Drohnen ein Online-Hearing zum Thema “Targeted Killing” organisiert, das am Freitag, dem 22. November 2024 von 18 bis 19:30 Uhr stattfinden wird und zu dem alle Interessierten herzlich eingeladen sind.

Programm:

18.00 Uhr – Begrüßung: Hans-Jörg Kreowski und Christian Heck (FIfF e. V. – Forum InformatikerInnen für Frieden und gesellschaftliche Verantwortung)

18.05 - 18.45 Uhr – Moderation: Angelika Wilmen (IPPNW – Internationale Ärztinnen für die Verhütung des Atomkriegs/Ärztinnen in sozialer Verantwortung)

- Der Mythos ‚Targeted Killing‘ - Zur Verantwortlichkeit bei Einsätzen KI-gestützter Tötungssysteme am Beispiel des Lavender- Programms

- Rainer Rehak (Weizenbaum-Institut / FIfF e. V. – Forum InformatikerInnen für Frieden und gesellschaftliche Verantwortung)

- 'Probably Approximately Correct'. Über algorithmische Kriegsführung, abduktive Mutmaßungen und automatisiertes >Völkerrecht<

- Jutta Weber (Universität Paderborn / MeHuCo - Meaningful Human Control)

- Disruption Network Institute: Investigating the Kill Cloud - Bringing transparency to the opacity of data-centric warfare (auf Englisch)

- Tatiana Bazzichelli (Director and Founder, Disruption Network Lab)

- Q & A

18.45 - 19.25 Uhr – Moderation: Angelika Wilmen (IPPNW – Internationale Ärztinnen für die Verhütung des Atomkriegs/Ärztinnen in sozialer Verantwortung)

- Das katastrophale Ende der Ethik im digitalen Krieg

- Elke Schwarz (Queen Mary University London / ICRAC – International Commitee for Robot Arms Control)

- targeted killing und der Status ziviler Opfer – ein philosophisches Problem?

- Jobst Paul (DISS – Duisburger Institut für Sprach- und Sozialforschung)

- Von ferngesteuerten zu autonomen Waffensystemen (AWS) – Gefahren für Völkerrecht und militärische Stabilität – wie kann man AWS verbieten?

- Jürgen Altmann (Technische Universität Dortmund / ICRAC – International Committee for Robot Arms Control)

- Q & A

19.25 Uhr – Schlußwort: Susanne Grabenhorst (IPPNW – Internationale Ärztinnen für die Verhütung des Atomkriegs/Ärztinnen in sozialer Verantwortung)

Aufzeichnung des Hearings:

Am 29. April veröffentlichten der Arbeitskreis gegen bewaffnete Drohnen, das Forum InformatikerInnen für Frieden und gesellschaftliche Verantwortung (FIfF e.V.) und die Informationsstelle Militarisierung (IMI e.V.) in einer gemeinsamen Pressemitteilung das Positionspapier „Targeted ? Killing“.

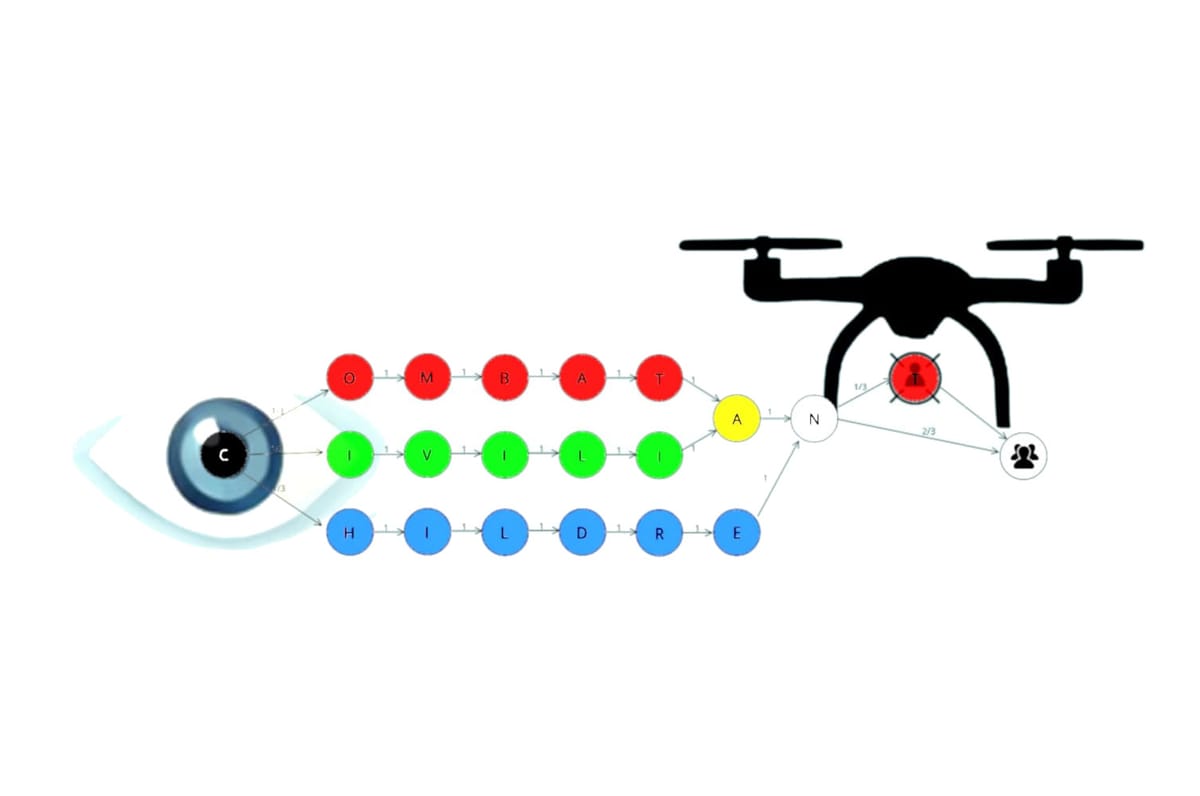

Das Papier bezog Stellung zu Yuval Abrahams Publikmachung von militärischen Einsätzen in Gaza mittels eines KI-gestützten Systems namens „Lavender“. Das System wurde Abrahams Recherchen zu Folge nach dem 7. Oktober von den israelischen Streitkräften eingesetzt. Es nutzte Mobilfunkdaten, GPS-Signale, biometrische Datenbanken der israelischen Geheimdienste usw., um Militärs der Hamas und des islamischen Dschihad zu identifizieren, Todesdatenbanken zu erstellen und daraufhin ihre Wohnhäuser mit Drohnen zu bombardieren.

Wir setzen uns für eine intensive öffentliche wissenschaftliche und zivilgesellschaftliche Debatte über das Targeted killing (zu deutsch: gezieltes Töten) mittels KI-gestützter Systeme ein. Das zunehmende Vertrauen in das datengetriebene (data driven) Targeting mit Identifizierungs- und Entscheidungsunterstützungs-Systemen, bereitet uns große Sorge.

„KI und die großen Überwachungsplattformen, die riesige KI-Systeme mit Daten füttern, steigern diese Fähigkeit auf unglaublich gefährliche Weise“, so die KI-Forscherin und CEO des Messenger-Dienstes „Signal“, Meredith Whittaker über sogenannte signature strikes, die auf Datenmustern beruhen.

Begriffe wie „Targeted Killing“, „Smart Bombs“ oder „Präzisionswaffen“ verschleiern die wahren Folgen und Konsequenzen. Sie führten nicht, wie verhießen, zu weniger zivilen Opfern. Diese werden in hohem Maße in Kauf genommen. Die Systeme nehmen Soldat*innen prädiktiv (vorhersagend), in Teilen sogar präemptiv (vorwegnehmend) moralische Entscheidungen ab und führen zu einer Dehumanisierung auf Täter- wie auch auf Opferseite.

Daher darf der Gebrauch des Begriffs „Targeted killing” nicht unhinterfragt in die zivilgesellschaftliche Analyse militärischer und sicherheitsbehördlicher Praxis einfließen.

Eines scheint sich nicht zu wandeln, und das ist der ungebrochene tödliche Eingriff in das Leben und der Gebrauch von Gewalt mittels Waffen und Technologie.

Im Online-Hearing werden Fragen der Verantwortung, der historischen Kontinuität und der Auswirkungen von solchem Gebrauch von KI-Systemen gemeinsam erörtert.

- Selbst wenn der Schutz der Zivilbevölkerung seitens der kriegführenden Parteien beabsichtigt wäre, ist er überhaupt realistisch?

- Lässt sich eine klare Trennung von menschlichem und maschinellem Handeln und Entscheiden aufrechterhalten?

- Wird der Mensch zu einer symbolischen Repräsentation, die benutzt, ersetzt oder zerstört werden kann? Und wenn ja, wie läuft diese Dehumanisierung ab?

- Was sagt die Forschung zu menschlicher Kontrolle, Verantwortung und Ethik in den derzeitigen bewaffneten Konflikten?

- Wie können Entscheidungen, die auf KI-gestützten Systemen basieren, validiert und so transparent gemacht werden, dass die Weltöffentlichkeit sie nachverfolgen kann?

- Und was können Wissenschaftler*innen tun, bzw. wie können sich Zivilgesellschaft und Aktivist*innen engagieren?

Hierzu wurden Expert*innen aus verschiedenen Fachbereichen eingeladen, um ihre jeweiligen Erkenntnisse in kurzen Vorträgen vorzustellen und mögliche Handlungsansätze zu präsentieren. Zudem wird es Raum für Rückfragen, Kommentare und Vernetzungsmöglichkeiten geben.

Vorträge:

Das katastrophale Ende der Ethik im digitalen Krieg

Elke Schwarz ist Professorin für politische Theorie an der Queen Mary University London (QMUL) und Leiterin des TheoryLab an der School of Politics and International Relations der QMUL. Ihr Forschungsschwerpunkt liegt auf der Schnittstelle von Ethik, Krieg und Technologie, insbesondere im Zusammenhang mit autonomen oder intelligenten Militärtechnologien und deren Auswirkungen auf die moderne Kriegsführung.

targeted killing und der Status ziviler Opfer - ein philosophisches Problem?

Jobst Paul ist Sprach- und Literaturwissenschaftler und wissenschaftlicher Mitarbeiter des Duisburger Instituts für Sprach- und Sozialforschung (DISS). Seine Arbeitsschwerpunkte sind die ideologischen Grundlagen westlicher Ausgrenzungskonstrukte. Er veröffentlichte Bücher und zahlreiche Aufsätze zur Ethik, u.a. zum Menschenbild in den Biowissenschaften, zuletzt die Sonderausgabe des DISS-Journals “Israel im Krieg”.

'Probably Approximately Correct'. Über algorithmische Kriegsführung, abduktive Mutmaßungen und automatisiertes >Völkerrecht<.

Jutta Weber ist ist Technikforscherin, Philosophin, Medientheoretikerin sowie Professorin für Mediensoziologie am Institut für Medienwissenschaft der Universität Paderborn. Ihre Forschungsschwerpunkte liegen auf Human-Computer Interaktion z.B. im Bereich der Künstlichen Intelligenz, der Robotik und der Informatik, den Critical Surveillance & Security Studies, u.v.w. Sie leitet derzeit die BMBF-Forschungsprojekte MEHUCO (Meaningful Human Control – Autonome Waffensysteme zwischen Regulation und Reflexion), Being Tagged: Die digitale Neuordnung der Welt und ist Mit-Organisatorin der Investigating the Kill Cloud – Information Warfare, Autonomous Weapons & AI.

Von ferngesteuerten zu autonomen Waffensystemen (AWS) - Gefahren für Völkerrecht und militärische Stabilität - wie kann man AWS verbieten?

Jürgen Altmann (wiss. Mitarbeiter i.R.), Arbeitsgruppe Physik und Abrüstung am Lehrstuhl Experimentelle Physik III, TU Dortmund. Er bearbeitet naturwissenschaftlich-technische Probleme der Abrüstung, insb. Militärtechnik-Folgenabschätzung und präventive Rüstungskontrolle. Größere Studien betrafen u.a. Laserwaffen, Raketenabwehr, nicht-tödliche Waffen und unbemannte Fahrzeuge; neuere Arbeiten behandelten militärische Stabilität mit autonomen Waffensystemen und vertrauensbildende Maßnahmen im Kontext von Cyber-Rüstung.

Der Mythos ‚Targeted Killing‘ - Zur Verantwortlichkeit bei Einsätzen KI-gestützter Tötungssysteme am Beispiel des Lavender- Programms

Rainer Rehak ist wiss. Mitarbeiter am Weizenbaum-Institut sowie am Wissenschaftszentrum Berlin für Sozialforschung und promoviert an der TU Berlin zu systemischer IT-Sicherheit, gesellschaftlichem Datenschutz und Technikfiktionen. Er ist Ko-Vorsitzender im Forum InformatikerInnen für Frieden und gesellschaftliche Verantwortung (FIfF e. V.), aktiv bei Amnesty International in der Expertengruppe »Menschenrechte im digitalen Zeitalter« und technischer Sachverständiger.

Disruption Network Institute: Investigating the Kill Cloud - Bringing transparency to the opacity of data-centric warfare (in english)

Tatiana Bazzichelli ist Gründerin und Direktorin des Disruption Network Lab, das sich mit Politik, Technologie und Gesellschaft, u.a. auch im Rahmen des Disruption Network Instituts und der anstehenden Konferenz über die Zukunft der Kriegsführung „Investigating the Kill Cloud - Information Warfare, Autonomous Weapons & AI“. Ihre Arbeitsschwerpunkte sind Hacktivismus, digitale Kultur, Kunst und Whistleblowing. 2021 erschien ihr Buch „Whistleblowing for Change“. Mehr info unter: https://www.disruptionlab.org/team

Begrüßung und Moderation:

Angelika Wilmen ist Geschäftsstellenleiterin und Friedensreferentin der „Internationalen Ärzte für die Verhütung des Atomkrieges/Ärzte in sozialer Verantwortung e. V.“ (IPPNW). Sie hat Germanistik, Rechtswissenschaften und Kunstgeschichte in Bonn studiert und vor ihrer Tätigkeit als Pressesprecherin des IPPNW als Journalistin unter anderem beim Kölner Stadt-Anzeiger und Bonner General-Anzeiger gearbeitet.

Christian Heck ist promovierender Forscher und künstlerisch- wissenschaftlicher Mitarbeiter für Ästhetik und neue Technologien / Experimentelle Informatik an der Kunsthochschule für Medien Köln (KHM). Seine Arbeit, Forschung und Lehre verbindet künstlerische Ausdrucks- und Forschungsmethoden mit Friedensarbeit und KI-Kritik. Er ist Mitglied im Forum InformatikerInnen für Frieden und gesellschaftliche Verantwortung (FIfF e. V.) und aktiv im Arbeitskreis gegen bewaffnete Drohnen.

Hans-Jörg Kreowski ist Professor (i.R.) für Theoretische Informatik an der Universität Bremen. Er ist Mitglied im Vorstand des Forum InformatikerInnen für Frieden und gesellschaftliche Verantwortung (FIfF e. V.) und Mitherausgeber der Zeitschrift Wissenschaft und Frieden. Von 2019 bis 2022 war er außerdem Mitherausgeber des Grundrechte-Reports. Im Rahmen der Leibniz-Sozietät der Wissenschaften zu Berlin organisiert er zusammen mit Wolfgang Hofkirchner in Wien den Arbeitskreis Emergente Systeme, Information und Gesellschaft. Inhaltlich beschäftigt er sich in Wort und Schrift vor allem mit der Verflechtung von Informatik und Rüstung sowie mit der Entlarvung der Technikmythen rund um Digitalisierung und Künstliche Intelligenz

Susanne Grabenhorst ist Ärztin für Psychiatrie, Psychosomatische Medizin und Psychotherapie in Mönchengladbach. Mitglied der IPPNW (Internationale Ärztinnen für die Verhütung des Atomkriegs/Ärztinnen in sozialer Verantwortung). Sprecherin der Kooperation für den Frieden, einem Zusammenschluss von über 50 deutschen Friedensorganisationen. Koordinatorin des Arbeitskreis gegen bewaffnete Drohnen.

Über den Arbeitskreis gegen bewaffnete Drohnen:

Der Arbeitskreis gegen bewaffnete Drohnen ist ein 2019 gegründetes Bündnis aus Organisationen, Netzwerken und Kampagnen der bundesweiten Friedensbewegung. Unser Ziel ist es, die gesamte Bandbreite zivilgesellschaftlicher Bewegungen zu vernetzen, die sich gegen Verletzungen grundlegender Menschenrechte durch militärische Drohnen zu Überwachungs- und bewaffneten Einsätzen engagieren. Wir klären auf über Forschung und Entwicklung neuer Technologien für autonome Waffensysteme sowie die Auswirkungen von Big Data und Künstlicher Intelligenz im militärischen Kontext.

Vorangegangene Veranstaltung

Online-Hearing vom März 2022

Videoaufzeichnungen des Online-Hearings März 2022